Decision Trees adalah metode analisis data yang menggunakan struktur pohon untuk memodelkan berbagai kemungkinan hasil. Metode ini populer karena mudah dipahami dan fleksibel. Anda dapat menggunakannya untuk menyelesaikan masalah klasifikasi atau regresi. Selain itu, Decision Trees sering menjadi dasar algoritma ensemble seperti random forest dan gradient boosting. Dalam analisis data, metode ini membantu Anda membuat keputusan yang lebih terstruktur dan efisien. Dengan pendekatan visualnya, Anda dapat memahami pola data yang kompleks dengan lebih mudah.

Poin Penting Decision Trees

- Decision Trees adalah metode analisis data yang menggunakan struktur pohon untuk memodelkan hasil, memudahkan pemahaman dan pengambilan keputusan.

- Struktur Decision Trees terdiri dari root node, internal nodes, branches, dan leaf nodes, yang membantu visualisasi proses pengambilan keputusan.

- Decision Trees dapat digunakan untuk klasifikasi dan regresi, dengan metrik yang berbeda seperti Gini Impurity untuk klasifikasi dan Mean Squared Error untuk regresi.

- Proses pembentukan Decision Trees melibatkan langkah-langkah seperti persiapan data, pemilihan algoritma, pelatihan model, dan evaluasi untuk memastikan akurasi.

- Keunggulan Decision Trees termasuk kemudahan interpretasi, fleksibilitas dalam menangani data kompleks, dan efisiensi dalam pengambilan keputusan.

- Decision Trees telah diterapkan di berbagai industri, termasuk layanan pelanggan, bisnis, pemasaran, dan kesehatan, untuk meningkatkan pengambilan keputusan berbasis data.

- Untuk mengoptimalkan penggunaan Decision Trees, teknik seperti pruning dan pemilihan algoritma yang tepat sangat penting untuk menghindari overfitting.

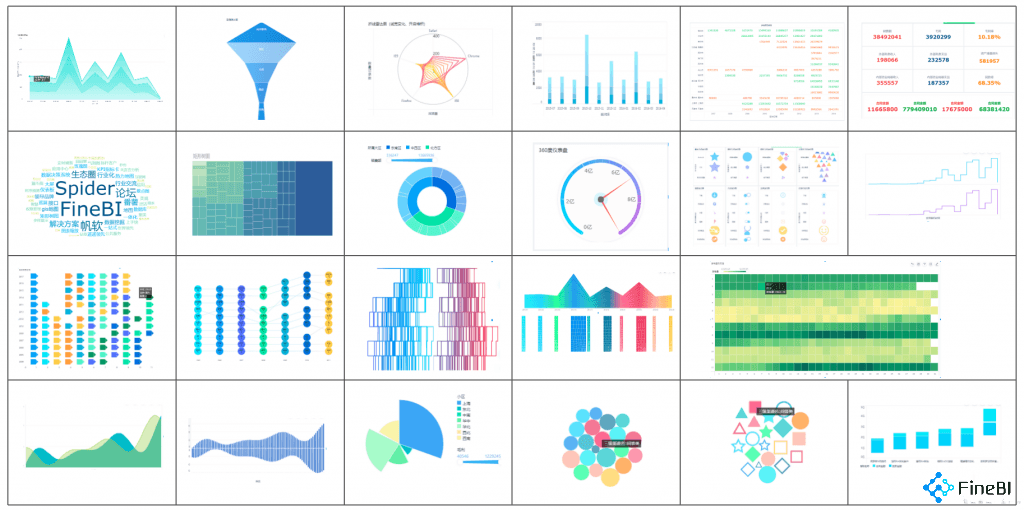

- Alat seperti FineBI dapat membantu dalam visualisasi Decision Trees, mempermudah pemahaman pola data dan meningkatkan kualitas analisis.

Apa Itu Decision Trees?

Definisi Decision Trees

Decision Tree, atau dalam bahasa Indonesia dikenal sebagai Pohon Keputusan, adalah metode analisis statistik yang sering digunakan dalam machine learning dan data mining. Metode ini membantu Anda membuat keputusan dan melakukan prediksi berdasarkan data yang tersedia. Secara visual, Decision Tree memiliki struktur seperti pohon. Node (simpul) merepresentasikan keputusan, cabang menunjukkan pilihan, dan daun (leaf node) menggambarkan hasil akhir atau prediksi dari model. Dengan pendekatan ini, Anda dapat memahami data secara lebih terstruktur dan logis.

Struktur Dasar Decision Trees

Struktur Decision Trees terdiri dari beberapa elemen utama yang bekerja bersama untuk menghasilkan keputusan atau prediksi. Berikut adalah elemen-elemen tersebut:

- Elemen

- Deskripsi

- Root node

- Titik awal pohon yang mewakili keseluruhan dataset

- Internal nodes

- Titik percabangan yang mewakili pengujian atribut

- Branches

- Hasil dari pengujian atribut yang menghubungkan antar node

- Leaf nodes

- Titik akhir pohon yang mewakili keputusan atau hasil klasifikasi

Node Keputusan (Decision Nodes)

Node keputusan adalah simpul yang digunakan untuk menentukan atribut mana yang akan diuji pada setiap langkah. Anda dapat menganggapnya sebagai titik di mana pohon mulai bercabang.

Cabang (Branches)

Cabang adalah jalur yang menghubungkan node satu dengan node lainnya. Cabang ini menunjukkan hasil dari pengujian atribut pada node sebelumnya.

Node Daun (Leaf Nodes)

Node daun adalah simpul terakhir dalam pohon. Node ini mewakili hasil akhir, seperti kategori dalam klasifikasi atau nilai numerik dalam regresi.

Jenis Decision Trees

Decision Trees dapat digunakan untuk berbagai tujuan, termasuk klasifikasi dan regresi. Berikut adalah perbedaan utama antara kedua jenis ini:

- Tipe Decision Tree

- Metrik yang Digunakan

- Klasifikasi

- Gini Impurity

- Regresi

- Mean Squared Error (MSE) / Mean Absolute Error (MAE)

Decision Trees untuk Klasifikasi

Decision Trees untuk klasifikasi membantu Anda memisahkan data ke dalam kategori tertentu. Misalnya, Anda dapat menggunakannya untuk menentukan apakah seorang pelanggan akan membeli produk atau tidak.

Decision Trees untuk Regresi

Decision Trees untuk regresi digunakan untuk memprediksi nilai numerik. Contohnya, Anda dapat memprediksi harga rumah berdasarkan atribut seperti lokasi, ukuran, dan jumlah kamar.

Bagaimana Cara Kerja Decision Trees?

Proses Pembentukan Decision Trees

Proses pembentukan Decision Trees melibatkan beberapa langkah penting. Setiap langkah dirancang untuk memastikan pohon keputusan yang dihasilkan dapat memberikan hasil yang akurat dan relevan. Berikut adalah langkah-langkah utama yang perlu Anda ketahui:

- Persiapan Data

Anda perlu mengumpulkan dan membersihkan data terlebih dahulu. Pastikan data bebas dari nilai yang hilang atau tidak relevan. Data yang berkualitas tinggi akan menghasilkan model yang lebih baik. - Pemilihan Algoritma

Pilih algoritma yang sesuai dengan kebutuhan Anda, seperti ID3, C4.5, atau CART. Setiap algoritma memiliki kelebihan dan kekurangan yang berbeda. - Penentuan Parameter

Tentukan parameter yang akan digunakan, seperti kedalaman maksimum pohon atau jumlah minimum data dalam setiap node. - Pelatihan Model

Gunakan data pelatihan untuk membangun Decision Trees. Proses ini melibatkan pemilihan atribut utama, pembagian data, dan pembentukan cabang. - Pruning (Opsional)

Lakukan pruning untuk mengurangi kompleksitas pohon dan mencegah overfitting. Langkah ini opsional tetapi sangat disarankan. - Evaluasi Model

Uji model menggunakan data uji untuk menilai akurasi dan kinerjanya. - Visualisasi dan Interpretasi

Visualisasikan Decision Trees untuk memahami pola dan keputusan yang dihasilkan. - Fine-tuning

Lakukan penyesuaian pada model berdasarkan hasil evaluasi untuk meningkatkan performa. - Implementasi

Setelah model siap, Anda dapat menggunakannya untuk membuat prediksi atau keputusan.

Pemilihan Atribut Utama

Pemilihan atribut utama adalah langkah penting dalam pembentukan Decision Trees. Anda perlu memilih atribut yang paling informatif untuk memisahkan data. Algoritma seperti ID3 menggunakan metode Information Gain, sedangkan C4.5 menggunakan Gain Ratio. Pemilihan atribut yang tepat akan menghasilkan pohon yang lebih efisien.

Pembagian Data Berdasarkan Atribut

Setelah atribut utama dipilih, data akan dibagi berdasarkan nilai atribut tersebut. Proses ini menciptakan cabang baru pada pohon. Setiap cabang mewakili hasil dari pengujian atribut pada node sebelumnya.

Pembentukan Cabang dan Node

Cabang dan node dibentuk secara berulang hingga semua data terklasifikasi dengan baik atau kriteria penghentian terpenuhi. Node daun akan terbentuk ketika tidak ada lagi pembagian data yang diperlukan.

Algoritma yang Digunakan dalam Decision Trees

Berbagai algoritma dapat digunakan untuk membangun Decision Trees. Berikut adalah beberapa algoritma yang paling umum:

ID3 (Iterative Dichotomiser 3)

ID3 adalah algoritma yang menggunakan Information Gain untuk memilih atribut terbaik. Algoritma ini bekerja dengan menghitung entropi setiap atribut dan memilih atribut dengan nilai Information Gain tertinggi.

C4.5

C4.5 adalah pengembangan dari ID3. Algoritma ini menggunakan Gain Ratio untuk mengatasi kelemahan ID3 dalam menangani atribut dengan banyak nilai unik. C4.5 juga mendukung data kontinu.

CART (Classification and Regression Trees)

CART adalah algoritma yang fleksibel karena dapat digunakan untuk klasifikasi dan regresi. Untuk klasifikasi, CART menggunakan Gini Impurity, sedangkan untuk regresi, algoritma ini menggunakan Mean Squared Error (MSE) atau Mean Absolute Error (MAE).

Manfaat Decision Trees dalam Analisis Data

Interpretasi yang Mudah

Decision Trees menawarkan struktur yang sederhana dan intuitif. Anda dapat dengan mudah memahami bagaimana keputusan dibuat karena setiap langkah dalam pohon menggambarkan proses pengambilan keputusan. Struktur pohon ini terdiri dari simpul akar, simpul internal, cabang, dan simpul daun. Elemen-elemen ini membantu Anda memvisualisasikan data secara lebih jelas. Misalnya, dalam konteks bisnis, Anda dapat melihat alasan di balik keputusan seperti "mengapa pelanggan tertentu membeli produk". Dalam dunia medis, Decision Trees mempermudah dokter untuk menjelaskan diagnosis kepada pasien berdasarkan gejala yang terdeteksi. Dengan pendekatan ini, bahkan orang tanpa latar belakang teknis dapat memahami hasil analisis data.

Kemampuan Menangani Data Kompleks

Decision Trees sangat fleksibel dalam menangani berbagai jenis data. Anda tidak perlu melakukan banyak pra-pemrosesan seperti normalisasi atau standarisasi. Metode ini juga mampu menangani nilai yang hilang tanpa memerlukan imputasi yang rumit. Selain itu, Decision Trees secara otomatis memilih atribut yang paling relevan, sehingga Anda dapat memahami fitur mana yang paling berpengaruh dalam dataset. Kemampuan ini sangat berguna ketika Anda bekerja dengan data yang memiliki pola non-linear. Misalnya, dalam analisis data pelanggan, Decision Trees dapat mengidentifikasi hubungan kompleks antara preferensi pelanggan dan kebiasaan belanja mereka. Dengan pendekatan ini, Anda dapat menangkap pola yang sulit diidentifikasi oleh metode lain.

Efisiensi dalam Pengambilan Keputusan

Setelah Decision Trees terbentuk, proses prediksi menjadi sangat cepat. Anda hanya perlu mengikuti jalur dari simpul akar ke simpul daun untuk mendapatkan hasil. Kecepatan ini membuat Decision Trees ideal untuk dataset besar. Selain itu, struktur pohon yang transparan membantu Anda membuat keputusan yang lebih informatif. Dalam dunia bisnis, misalnya, Anda dapat menggunakan Decision Trees untuk memprediksi penjualan berdasarkan data historis. Dalam analisis risiko, metode ini membantu Anda mengidentifikasi faktor-faktor utama yang memengaruhi hasil tertentu. Dengan efisiensi ini, Anda dapat menghemat waktu dan sumber daya dalam proses pengambilan keputusan.

Fleksibilitas untuk Berbagai Jenis Data

Decision Trees menawarkan fleksibilitas luar biasa dalam menangani berbagai jenis data. Anda dapat menggunakan metode ini untuk data numerik maupun kategorikal tanpa perlu melakukan transformasi khusus. Hal ini menghemat waktu dan usaha dalam tahap persiapan data. Selain itu, Decision Trees tidak memerlukan normalisasi atau standarisasi data yang ekstensif. Anda dapat langsung menggunakannya pada dataset yang kompleks tanpa harus khawatir tentang format data.

Metode ini juga sangat efektif untuk menangani pola data non-linier. Dalam banyak kasus, hubungan antara variabel dalam dataset tidak selalu linier. Decision Trees mampu mengidentifikasi pola-pola ini dengan membagi data ke dalam kelompok yang lebih kecil berdasarkan atribut tertentu. Misalnya, jika Anda memiliki data pelanggan dengan berbagai preferensi, Decision Trees dapat membantu Anda memahami hubungan antara preferensi tersebut dan kebiasaan belanja mereka.

Fleksibilitas ini menjadikan Decision Trees sebagai alat yang sangat berguna untuk berbagai aplikasi analisis data. Anda dapat menggunakannya untuk klasifikasi, regresi, atau bahkan untuk memahami hubungan kompleks dalam dataset yang besar. Dengan pendekatan ini, Anda dapat fokus pada analisis tanpa harus menghabiskan banyak waktu untuk mempersiapkan data.

Penggunaan Decision Trees dalam Berbagai Industri

Decision Trees telah digunakan secara luas di berbagai industri untuk mendukung pengambilan keputusan yang lebih baik. Berikut adalah beberapa contoh nyata penerapan Decision Trees dalam berbagai sektor:

Contoh Penggunaan

- Layanan Pelanggan

Memanfaatkan Decision Trees untuk memprediksi kemungkinan pelanggan berhenti menggunakan layanan mereka.

- Bisnis

Mengevaluasi peluang pertumbuhan prospektif berdasarkan data historis penjualan.

- Pemasaran

Menggunakan data demografis untuk menemukan calon klien dan merampingkan anggaran pemasaran.

- Real Estate

Memperkirakan harga properti berdasarkan lokasi, ukuran, usia bangunan, dan fasilitas sekitar.

- Perbankan & E-commerce

Mengidentifikasi pola transaksi mencurigakan sebagai bagian dari sistem deteksi penipuan.

Dalam layanan pelanggan, Decision Trees membantu Anda memahami faktor-faktor yang memengaruhi loyalitas pelanggan. Anda dapat memprediksi apakah pelanggan akan tetap menggunakan layanan Anda atau tidak. Di sektor pemasaran, Decision Trees memungkinkan Anda mengidentifikasi target pasar yang paling potensial. Dengan cara ini, Anda dapat mengoptimalkan anggaran pemasaran dan meningkatkan efisiensi kampanye.

Di industri real estate, Decision Trees digunakan untuk memperkirakan harga properti. Anda dapat mempertimbangkan berbagai faktor seperti lokasi, ukuran, dan fasilitas untuk memberikan estimasi yang akurat. Dalam perbankan dan e-commerce, Decision Trees memainkan peran penting dalam mendeteksi penipuan. Dengan menganalisis pola transaksi, Anda dapat mengidentifikasi aktivitas mencurigakan dan mengambil tindakan pencegahan.

Fleksibilitas dan kemampuan Decision Trees untuk menangani berbagai jenis data menjadikannya alat yang sangat berharga di berbagai industri. Anda dapat menggunakannya untuk meningkatkan efisiensi, mengurangi risiko, dan membuat keputusan yang lebih baik berdasarkan data.

Contoh Penerapan Decision Trees

Penerapan dalam Bisnis

Analisis Pelanggan

Dalam dunia bisnis, Decision Trees membantu Anda memahami perilaku pelanggan dengan lebih baik. Alat ini sering digunakan untuk:

- Memprediksi kemungkinan pelanggan berhenti menggunakan layanan. Dengan informasi ini, Anda dapat mengidentifikasi faktor-faktor yang berkontribusi terhadap churn dan mengambil langkah pencegahan.

- Menganalisis data demografi untuk menemukan calon klien potensial. Pendekatan ini membantu Anda merampingkan anggaran pemasaran dan meningkatkan efisiensi kampanye.

Dengan Decision Trees, Anda dapat mengoptimalkan strategi bisnis berdasarkan data yang tersedia.

Prediksi Penjualan

Decision Trees juga memainkan peran penting dalam memprediksi penjualan. Anda dapat menggunakannya untuk:

- Mengevaluasi peluang pertumbuhan bisnis berdasarkan data historis.

- Menggunakan data demografi untuk mengidentifikasi pasar yang paling potensial.

Pendekatan ini memungkinkan Anda membuat keputusan yang lebih terinformasi dan meningkatkan peluang keberhasilan bisnis.

Penerapan dalam Kesehatan

Diagnosis Penyakit

Di bidang kesehatan, Decision Trees membantu dokter dalam proses diagnosis. Alat ini mempertimbangkan gejala, riwayat medis, dan hasil tes untuk memberikan rekomendasi diagnosis atau tindakan lanjutan. Dengan pendekatan ini, Anda dapat memberikan diagnosis yang lebih cepat dan akurat.

Prediksi Risiko Pasien

Selain diagnosis, Decision Trees juga digunakan untuk memprediksi risiko pasien. Alat ini membantu Anda:

- Mengidentifikasi faktor-faktor yang berkontribusi pada risiko penyakit.

- Memberikan rekomendasi pengobatan yang lebih tepat dan memungkinkan upaya pencegahan lebih dini.

Dengan kemampuan ini, Decision Trees mendukung pengambilan keputusan medis yang lebih baik.

Penerapan dalam Teknologi

Sistem Rekomendasi

Dalam teknologi, Decision Trees sering digunakan dalam sistem rekomendasi. Anda dapat memanfaatkannya untuk:

- Memprediksi preferensi pengguna berdasarkan riwayat pembelian atau tontonan sebelumnya.

- Memberikan rekomendasi yang lebih relevan di platform e-commerce atau streaming.

Pendekatan ini meningkatkan pengalaman pengguna dan membantu Anda memahami kebutuhan mereka dengan lebih baik.

Analisis Data IoT

Decision Trees juga digunakan dalam analisis data IoT. Alat ini membantu Anda mengidentifikasi pola dalam data yang dihasilkan oleh perangkat IoT. Dengan informasi ini, Anda dapat mengoptimalkan kinerja perangkat dan meningkatkan efisiensi operasional.

Decision Trees menawarkan fleksibilitas yang luar biasa untuk berbagai aplikasi. Anda dapat menggunakannya untuk meningkatkan efisiensi, mengurangi risiko, dan membuat keputusan yang lebih baik berdasarkan data.

Penerapan dengan FineBI

Penggunaan FineBI untuk Visualisasi Decision Trees

FineBI mempermudah Anda dalam memvisualisasikan Decision Trees. Alat ini menyediakan antarmuka yang intuitif untuk menggambarkan struktur pohon keputusan secara jelas. Dengan FineBI, Anda dapat melihat aturan-aturan keputusan dalam bentuk visual yang mudah dipahami. Setiap simpul dan cabang dalam Decision Trees ditampilkan secara terorganisir, sehingga Anda dapat mengikuti alur pengambilan keputusan dengan lebih baik.

Visualisasi yang dihasilkan oleh FineBI membantu Anda memahami pola data yang kompleks. Anda dapat melihat bagaimana atribut-atribut tertentu memengaruhi hasil akhir. Misalnya, dalam analisis pelanggan, Anda dapat mengidentifikasi faktor-faktor utama yang memengaruhi keputusan pembelian. Selain itu, FineBI memungkinkan Anda untuk menyesuaikan tampilan visual sesuai kebutuhan. Anda dapat menambahkan warna, label, atau anotasi untuk memperjelas informasi yang ingin disampaikan.

Keunggulan lain dari FineBI adalah kemampuannya untuk menangani dataset besar. Anda dapat memvisualisasikan Decision Trees yang kompleks tanpa kehilangan detail penting. Dengan fitur ini, Anda dapat menganalisis data secara lebih efisien dan membuat keputusan yang lebih terinformasi.

Keunggulan FineBI dalam Analisis Data

FineBI menawarkan berbagai keunggulan yang membuat analisis data menjadi lebih efektif. Pertama, alat ini dirancang untuk mempermudah interpretasi data. Anda tidak perlu memiliki latar belakang teknis yang mendalam untuk memahami hasil analisis. FineBI menyajikan data dalam format visual yang sederhana namun informatif.

Kedua, FineBI mendukung berbagai jenis data, baik numerik maupun kategorikal. Anda dapat mengintegrasikan data dari berbagai sumber tanpa perlu melakukan banyak pra-pemrosesan. Hal ini menghemat waktu dan memungkinkan Anda untuk fokus pada analisis.

Ketiga, FineBI memiliki kemampuan untuk mengidentifikasi pola-pola penting dalam data. Dengan Decision Trees, Anda dapat menemukan hubungan antara variabel yang mungkin tidak terlihat pada pandangan pertama. Misalnya, dalam analisis risiko, FineBI membantu Anda mengidentifikasi faktor-faktor yang paling memengaruhi hasil tertentu.

Keunggulan lainnya adalah fleksibilitas FineBI dalam berbagai industri. Anda dapat menggunakannya untuk analisis bisnis, kesehatan, teknologi, atau sektor lainnya. Dengan FineBI, Anda dapat meningkatkan efisiensi kerja dan membuat keputusan yang lebih baik berdasarkan data.

FineBI tidak hanya mempermudah visualisasi Decision Trees tetapi juga meningkatkan kualitas analisis data Anda. Dengan alat ini, Anda dapat memahami data secara lebih mendalam dan mengambil langkah-langkah strategis yang tepat.

Kelebihan dan Kekurangan Decision Trees

Kelebihan Decision Trees

Mudah Dipahami

Decision Trees memiliki keunggulan utama dalam hal kemudahan pemahaman. Struktur pohon yang dihasilkan menyerupai cara manusia berpikir saat membuat keputusan. Hal ini membuat metode ini intuitif dan mudah dimengerti, bahkan oleh orang yang tidak memiliki latar belakang teknis. Anda dapat melihat alur logika pengambilan keputusan secara visual, mulai dari simpul akar hingga simpul daun.

Selain itu, hasil dari Decision Trees sangat mudah dibaca dan diinterpretasikan. Anda tidak memerlukan pengetahuan statistik yang mendalam untuk memahami outputnya. Misalnya, dalam analisis pelanggan, Anda dapat dengan cepat mengetahui faktor-faktor yang memengaruhi keputusan pembelian. Kemudahan ini menjadikan Decision Trees sebagai alat yang sangat efektif untuk komunikasi hasil analisis kepada tim atau klien.

Tidak Membutuhkan Banyak Pra-Pemrosesan Data

Keunggulan lain dari Decision Trees adalah kemampuannya untuk bekerja dengan data mentah. Anda tidak perlu melakukan banyak pra-pemrosesan seperti normalisasi atau standarisasi. Metode ini juga dapat menangani data numerik dan kategorikal secara langsung.

Selain itu, Decision Trees mampu menangani nilai yang hilang tanpa memerlukan imputasi yang rumit. Anda hanya perlu memastikan bahwa data yang digunakan cukup representatif. Dengan fleksibilitas ini, Anda dapat menghemat waktu dalam tahap persiapan data dan fokus pada analisis.

Kekurangan Decision Trees

Rentan terhadap Overfitting

Salah satu kelemahan utama Decision Trees adalah kecenderungannya untuk overfitting. Pohon yang terlalu kompleks sering kali menyesuaikan diri dengan data training secara berlebihan. Akibatnya, model menjadi kurang efektif saat digunakan pada data baru. Anda perlu menggunakan teknik seperti pruning untuk mengurangi risiko ini.

Overfitting juga dapat terjadi jika pohon memiliki terlalu banyak simpul atau cabang. Hal ini membuat model kehilangan generalisasi dan hanya bekerja baik pada dataset tertentu. Oleh karena itu, Anda harus berhati-hati dalam menentukan parameter seperti kedalaman maksimum pohon.

Sensitif terhadap Perubahan Data

Decision Trees sangat sensitif terhadap perubahan kecil dalam data. Misalnya, jika Anda menambahkan atau menghapus beberapa data, struktur pohon dapat berubah secara signifikan. Hal ini membuat model menjadi kurang stabil dibandingkan metode lain.

Selain itu, Decision Trees cenderung bias terhadap fitur dengan banyak kategori unik. Fitur seperti ini sering kali dipilih sebagai atribut utama, meskipun tidak selalu relevan. Anda perlu mempertimbangkan hal ini saat membangun model untuk memastikan hasil yang lebih akurat.

Tips Mengoptimalkan Penggunaan Decision Trees

Menggunakan Teknik Pruning

Pruning adalah salah satu cara terbaik untuk meningkatkan kinerja Decision Trees. Teknik ini membantu menyederhanakan pohon keputusan dengan menghapus cabang-cabang yang tidak relevan atau terlalu kompleks. Dengan pruning, Anda dapat mengurangi risiko overfitting, yaitu ketika model terlalu menyesuaikan diri dengan data pelatihan sehingga kurang efektif pada data baru.

Pruning juga meningkatkan kemampuan generalisasi model. Pohon yang lebih sederhana cenderung memberikan hasil yang lebih akurat pada data yang belum pernah dilihat sebelumnya. Anda dapat menggunakan dua jenis pruning, yaitu pre-pruning dan post-pruning. Pre-pruning menghentikan pembentukan cabang lebih awal, sedangkan post-pruning menghapus cabang setelah pohon selesai dibangun.

Tips: Selalu evaluasi model Anda setelah melakukan pruning untuk memastikan akurasi tetap optimal.

Memilih Algoritma yang Tepat

Pemilihan algoritma yang sesuai sangat penting untuk mendapatkan hasil terbaik dari Decision Trees. Jika Anda bekerja dengan data kategorikal, CHAID bisa menjadi pilihan yang tepat. Untuk regresi dengan pola non-linear, MARS menawarkan solusi yang lebih baik. Anda perlu memahami kebutuhan analisis Anda sebelum memilih algoritma.

Menggabungkan dengan Metode Lain (Ensemble Methods)

Metode ensemble adalah cara lain untuk meningkatkan akurasi Decision Trees. Dengan menggabungkan beberapa model, Anda dapat mengurangi kesalahan dan meningkatkan stabilitas prediksi. Dua metode ensemble yang populer adalah Bagging dan Boosting:

- Bagging: Metode ini menciptakan beberapa versi data pelatihan dengan pengambilan sampel acak. Setiap subset data digunakan untuk melatih model yang berbeda. Hasil akhirnya adalah rata-rata atau voting dari semua model.

- Boosting: Metode ini fokus pada memperbaiki kesalahan model sebelumnya. Setiap model baru dilatih untuk memperbaiki kelemahan model sebelumnya, sehingga menghasilkan prediksi yang lebih akurat.

Metode ensemble seperti Random Forest dan Gradient Boosting sering digunakan dalam analisis data. Anda dapat memanfaatkan pendekatan ini untuk meningkatkan performa Decision Trees, terutama pada dataset yang kompleks.

Catatan: Metode ensemble membutuhkan lebih banyak sumber daya komputasi, tetapi hasilnya sering kali sepadan dengan usaha yang Anda lakukan.

Decision Trees adalah metode analisis data yang sederhana dan efektif. Anda dapat menggunakannya untuk memahami data dengan lebih mudah, berkat struktur visualnya yang intuitif. Metode ini juga fleksibel, mampu menangani data kompleks tanpa banyak pra-pemrosesan. Namun, untuk memaksimalkan penggunaannya, Anda perlu memahami kelebihan dan kekurangannya:

- Kelebihan:

- Mudah dipahami dan diinterpretasikan.

- Tidak memerlukan banyak pra-pemrosesan data.

- Mampu menangani nilai yang hilang.

- Memilih fitur yang paling relevan secara otomatis.

- Efektif untuk pola data non-linear.

- Kekurangan:

- Rentan terhadap overfitting.

- Sensitif terhadap perubahan data.

- Bias terhadap fitur dengan banyak kategori.

- Kurang optimal untuk prediksi nilai kontinu.

Dengan alat seperti FineBI, Anda dapat mengimplementasikan Decision Trees secara efisien. Memahami kelebihan dan kekurangan ini akan membantu Anda membuat keputusan yang lebih baik berdasarkan data.

Lihat juga tentang Decision Trees

Pengertian Data Lake Dan Pentingnya Dalam Analisis

Pengurangan Data: Strategi Efisien Untuk Penyimpanan

FAQ

Decision Trees adalah metode analisis data berbasis struktur pohon. Metode ini membantu Anda membuat keputusan atau prediksi berdasarkan data. Setiap simpul dalam pohon mewakili keputusan, dan cabang menunjukkan hasil dari keputusan tersebut.

Tidak. Anda dapat menggunakan Decision Trees untuk klasifikasi dan regresi. Untuk klasifikasi, pohon memisahkan data ke dalam kategori. Untuk regresi, pohon memprediksi nilai numerik berdasarkan atribut tertentu.

Decision Trees mudah dipahami dan diinterpretasikan. Anda tidak perlu banyak pra-pemrosesan data. Metode ini juga fleksibel untuk data numerik dan kategorikal serta mampu menangani pola non-linear.

Gunakan teknik pruning untuk menyederhanakan pohon. Anda juga dapat membatasi kedalaman maksimum pohon atau jumlah data minimum dalam setiap simpul. Metode ensemble seperti Random Forest juga membantu mengurangi overfitting.

Ya, Decision Trees bekerja dengan baik pada dataset besar. Proses prediksi cepat setelah pohon terbentuk. Namun, untuk dataset yang sangat besar, metode ensemble seperti Random Forest lebih efisien.

Algoritma populer meliputi ID3, C4.5, dan CART. ID3 menggunakan Information Gain, C4.5 menggunakan Gain Ratio, dan CART cocok untuk klasifikasi serta regresi dengan Gini Impurity atau MSE.

Ya, Decision Trees mampu menangani nilai hilang. Anda tidak perlu melakukan imputasi yang rumit. Pohon akan tetap memilih atribut yang paling relevan meskipun ada data yang hilang.

FineBI menyediakan antarmuka intuitif untuk memvisualisasikan Decision Trees. Anda dapat melihat struktur pohon secara jelas, memahami pola data, dan menyesuaikan tampilan visual sesuai kebutuhan. Alat ini mempermudah analisis data Anda.

Lanjutkan Membaca Tentang Decision Trees

Analisis Data Eksplorasi (EDA): Arti, Manfaat, dan Contohnya

Dalam artikel ini, kami akan menjelaskan apa itu Analisis Data Eksplorasi, memperkenalkan tiga jenis EDA dan cara melakukannya!

Lewis

2024 Agustus 05

Apa itu Analisis Data : Arti, Metode, Jenis, dan Manfaatnya

Apa itu analisis data? Analisis data adalah proses mengolah informasi untuk menemukan pola, tren, dan wawasan yang berguna dalam pengambilan keputusan.

Lewis

2025 Februari 24

Apa itu Laporan Transaksi dan Manfaatnya

Laporan transaksi adalah dokumen yang mencatat pemasukan, pengeluaran, dan transfer dana. Fungsinya membantu analisis keuangan dan pengambilan keputusan bisnis.

Lewis

2025 Maret 18

Apa Itu Business Intelligence Analyst

Business Intelligence Analyst mengolah data menjadi wawasan strategis, membantu perusahaan modern meningkatkan efisiensi, daya saing, dan pengambilan keputusan.

Lewis

2024 November 27

Apa Itu Neraca Analitik dan Fungsinya

Neraca analitik adalah alat laboratorium untuk mengukur massa dengan akurasi tinggi hingga 0,0001 gram. Alat ini penting untuk penelitian dan kontrol kualitas.

Lewis

2025 Februari 23

Apa Itu Boxplot ? Pengertian, Fungsi, dan Cara Kerjanya

Boxplot adalah alat visualisasi statistik yang menampilkan distribusi data melalui median, kuartil, dan outlier untuk analisis data yang lebih dalam dan jelas.

Lewis

2024 November 19